Hausarbeiten, E-Mails, Berichte – in vielen Bereichen ersetzt KI bereits den menschlichen Ausdruck. Was bleibt vom Denken, wenn niemand mehr schreibt? Eine persönliche und kritische Reflexion aus dem Klassenzimmer und darüber hinaus.

- Einleitung

- Der Siegeszug im Klassenzimmer

- Technik kontrolliert Technik

- Vom Werkzeug zur Auslagerung: Die schleichende Aushöhlung der Autorschaft

- Bildung als Ort des Unvollkommenen

- Ein Plädoyer für das Eigentum am Ausdruck

Einleitung

Zur Zeit lässt sich eine fundamentale Verschiebung im Bildungsbereich beobachten – eine, die sich nicht nur auf neue Technologien beschränkt, sondern das Verständnis von Leistung, Autorschaft und Lernen selbst berührt. In meiner Tätigkeit als Lehrkraft an einer beruflichen Schule hat sich binnen weniger Monate eine neue Realität etabliert: Nahezu alle Schülerinnen und Schüler arbeiten regelmäßig mit generativer KI. Ein paralleler Browser-Tab mit ChatGPT gehört zur Standardausrüstung, Texte werden automatisiert formuliert, sprachlich perfektioniert und inhaltlich homogen. Was auf den ersten Blick wie eine willkommene Effizienzsteigerung erscheint, wirft bei genauerem Hinsehen tiefgreifende Fragen auf. Insbesondere, wenn Sprache, Denken und Leistung entkoppelt werden.

Diese Beobachtungen lassen sich jedoch nicht auf das Klassenzimmer beschränken. Auch in meinem Nebenberuf im Abendservice eines gehobenen Restaurants zeigt sich ein ähnliches Bild: Anwälte, Apotheker, Bauingenieure, Investmentbanker – also Berufsgruppen, in denen schriftliche Kommunikation und kognitive Leistung zentral sind – berichten beiläufig und fast selbstverständlich davon, ihre Berichte, Schriftsätze oder E-Mails routinemäßig mit Hilfe von KI-Tools zu verfassen. Die Werkzeuge, die einst zur Assistenz gedacht waren, werden zunehmend zur Delegation des Denkens genutzt. Dabei stellt sich nicht nur die didaktische Frage, wie man Bildung in Zeiten künstlicher Sprachproduktion organisiert, sondern auch eine tiefere, fast schon philosophische:

Was geschieht mit dem Menschen, wenn er sich dauerhaft der eigenen Ausdrucksarbeit verweigert?

Im Folgenden wird daher zunächst der derzeitige Stand der Nutzung generativer KI im Bildungskontext beleuchtet, bevor im zweiten Teil die kulturellen und erkenntnistheoretischen Implikationen dieses Wandels diskutiert werden. Ziel ist es, das Phänomen nicht nur als technologischen Fortschritt oder als didaktisches Problem zu erfassen, sondern als ein Symptom einer breiter angelegten Veränderung unseres Verhältnisses zu Sprache, Denken und Subjektivität.

Der Siegeszug im Klassenzimmer

Der Einsatz generativer KI ist natürlich kein Nischenphänomen mehr. Laut einer globalen Erhebung nutzen 86 % der Studierenden regelmäßig KI-Tools zur Unterstützung ihrer Studienleistungen, insbesondere in den Geisteswissenschaften1. Dabei werden Programme wie ChatGPT nicht nur zur Inspiration oder Korrektur verwendet, sondern zunehmend zur vollständigen Erstellung von Textbeiträgen. Die einfache Bedienbarkeit, die Qualität der Ergebnisse und der fehlende soziale Stigmatisierungsdruck fördern diesen Trend.

Diese Entwicklung ist keineswegs auf Hochschulen beschränkt. Auch an beruflichen Schulen – traditionell praxisnäher ausgerichtet – ist KI allgegenwärtig. Besonders problematisch erscheint, dass viele Lernprodukte nicht mehr auf dem eigenen Denkprozess der Lernenden basieren, sondern zu einer „textlichen Glättung“ durch generative Tools tendieren. Diese Tendenz birgt die Gefahr, dass die Fähigkeit zur eigenständigen Argumentation verkümmert.

Warum sind die Geisteswissenschaften besonders betroffen?

Ein wesentlicher Grund für die hohe Durchdringung in bestimmten Fächern liegt in der Aufgabenstruktur: Während MINT-Fächer (Mathematik, Informatik, Naturwissenschaften, Technik) verstärkt auf nachvollziehbare Problemlösungen, logische Begründungen und empirisch überprüfbare Ergebnisse setzen, dominieren in den Geistes- und Sozialwissenschaften textzentrierte Prüfungsformate. Diese lassen sich mit KI-Tools vergleichsweise einfach imitieren oder gar vollständig ersetzen2. Die Algorithmen sind so trainiert, dass sie kohärente, rhetorisch ausgefeilte, aber nicht zwingend originelle Texte erzeugen – was im geisteswissenschaftlichen Kontext problematisch ist, da hier nicht nur formale Korrektheit, sondern die argumentative Eigenständigkeit zentral ist.

Akademische Integrität im Wandel

Die Tertiary Education Quality and Standards Agency (TEQSA) in Australien warnt in einem aktuellen Bericht vor einem erheblichen Risiko für die akademische Integrität durch generative KI. Dabei wird betont, dass nicht nur der Umfang, sondern auch die Qualität der unerlaubten Nutzung zugenommen habe. Die Behörde sieht Handlungsbedarf sowohl in der kurz- als auch langfristigen Gestaltung bildungspolitischer Reaktionen3.

Problematisch ist dabei nicht nur die Täuschung durch Studierende, sondern auch die Unsicherheit von Lehrkräften hinsichtlich der Bewertung solcher Leistungen. Viele Lehrerinnen und Lehrer – mich eingeschlossen – setzen inzwischen selbst KI ein, um Texte auf verdächtige Muster hin zu überprüfen oder mit früheren Arbeiten zu vergleichen. Dies führt zu einem paradoxen Zustand: Während Schüler KI verwenden, um Texte zu verfassen, nutzen Lehrende dieselbe Technologie zur Überprüfung. Die Bildung gerät in einen technologischen Zirkel, der Reflexion und persönliche Entwicklung zu ersetzen droht.

Technik kontrolliert Technik

Dummerweise brauchen wir mittlerweile KI, um KI zu erkennen. Ein Paradoxon, das sich auf den ersten Blick wie eine Kapitulation vor der Technik liest. Doch auch dieser Mechanismus ist nicht neu: Auch in anderen gesellschaftlichen Bereichen haben sich Systeme etabliert, in denen Technik notwendig wird, um die Wirkungen anderer Technik einzufangen. So nutzen wir seit Jahren Spamfilter, um automatisierte Werbemails zu erkennen, Virenscanner zum Schutz vor digitaler Schadsoftware oder algorithmische Verfahren zur Aufdeckung von Marktmanipulation im Börsenhandel. Selbst in der Wissenschaftspraxis haben sich Plagiaterkennungssysteme etabliert, die auf digitale Recherchestrategien reagieren – also Technik gegen Technik setzen, um intellektuelle Standards zu wahren.

Diese Entwicklungen zeigen

Nicht jeder technologische Rückgriff zur Kontrolle eines anderen ist Ausdruck technischer Selbstüberschätzung

Oft ist er schlicht notwendig, um neue Risiken zu minimieren. Entscheidend ist daher nicht, dass Technik Technik begegnet – sondern wie sie das tut: unter wessen Kontrolle, mit welchen Zielen und in welcher pädagogischen Einbettung. Die Herausforderung besteht nicht in der Techniknutzung selbst, sondern darin, die Autonomie des Denkens und die Transparenz der Leistung trotz technologischer Hilfsmittel zu erhalten.

Detektionstools: Lösung oder Scheinlösung?

Viele Bildungseinrichtungen setzen mittlerweile auf Tools zur KI-Erkennung. Eine Umfrage des Center for Democracy & Technology zeigt, dass 68 % der Lehrkräfte entsprechende Programme verwenden4. Doch diese Technologien sind fehleranfällig: Falsch-positive Ergebnisse führen zu ungerechtfertigten Plagiatsvorwürfen, was das Vertrauensverhältnis im Bildungsprozess unterminiert. Zudem umgehen immer mehr Schüler die Erkennung durch sogenannte „Undetectable AI Tools“, die gezielt für menschlich wirkende Ausdrucksweisen trainiert sind.

Statt ein pädagogisches Verhältnis zu pflegen, das auf Kommunikation, Entwicklung und Vertrauen basiert, entsteht ein Klima des Verdachts, in dem technische Kontrolle an die Stelle dialogischer Auseinandersetzung tritt. Der eigentliche Bildungsauftrag – die Förderung von Selbstständigkeit, Urteilskraft und Ausdrucksfähigkeit – gerät dabei aus dem Blick. Wenn Prüfungen primär dazu dienen, Manipulationen zu entlarven, und Lernende sich gezwungen sehen, ihre Kreativität in der Umgehung von Erkennungssystemen zu beweisen, verschiebt sich der Fokus: weg vom Inhalt, hin zur Oberfläche der Performanz.

Auch ich selbst ertappe mich beim Korrigieren immer häufiger dabei, Hausarbeiten mit einem Grundverdacht zu lesen. Besonders bei sehr guten Arbeiten, die sprachlich wie formell überdurchschnittlich ausfallen, werde ich hellhörig. Nicht weil ich weiß, was in dieser Altersgruppe sprachlich realistisch ist, sondern auch, weil ich meine Schülerinnen und Schüler aus dem Unterricht kenne.

So sehr man sich auch um Objektivität bemüht, wenn eine Leistung stark aus dem individuellen Raster fällt, liegt der Verdacht nahe, dass sie nicht ausschließlich auf eigener Leistung beruht. Das Bewertungsverhältnis verschiebt sich dadurch stillschweigend – weg von der inhaltlichen Würdigung hin zur Suchbewegung nach möglichen Spuren fremder, generativ- technischer Autorschaft.

Langfristig droht so eine strukturelle Verschiebung des Bildungsideals. Von einem Raum des Denkens hin zu einem Spiel technischer Kontroll- und Umgehungsstrategien. Die Frage ist daher nicht nur, ob wir KI erkennen können, sondern vielmehr, was wir mit dieser Erkenntnis anfangen – und ob sie uns zurückführt zum Lernen oder nur tiefer hinein in ein System der Simulation.

Vom Werkzeug zur Auslagerung: Die schleichende Aushöhlung der Autorschaft

Die Diskussion um generative KI lässt sich nicht länger als rein didaktische oder technologische Herausforderung behandeln. Vielmehr stellt sie die fundamentale Frage nach dem Verhältnis von Subjekt und Leistung, von Mensch und Ausdruck. Diese Problematik wird nicht nur im Klassenzimmer sichtbar, sondern entfaltet sich auch in einem gänzlich anderen Kontext: meinem Abendservice in einem Restaurant.

Dort, wo ich neben meinem Studium arbeite, sitzen in dunklem Leder und bei (wirklich) gutem Essen: Anwälte, Apotheker, Bauingenieure, Investmentbanker – akademisch geprägte Berufsgruppen, oft eloquent, stets gut gekleidet, rhetorisch präzise. Was mich überrascht: Neben Gesprächen über Steueroptimierung und Immobilienanlagen ist KI in nahezu jedem Gespräch präsent. Fast beiläufig und mit Stolz, wird erwähnt, dass Berichte, Protokolle, Schriftsätze, Gutachten oder E-Mails mittlerweile „von ChatGPT“ erstellt werden. Nicht, weil man es nicht könnte – sondern weil man es nicht mehr will.

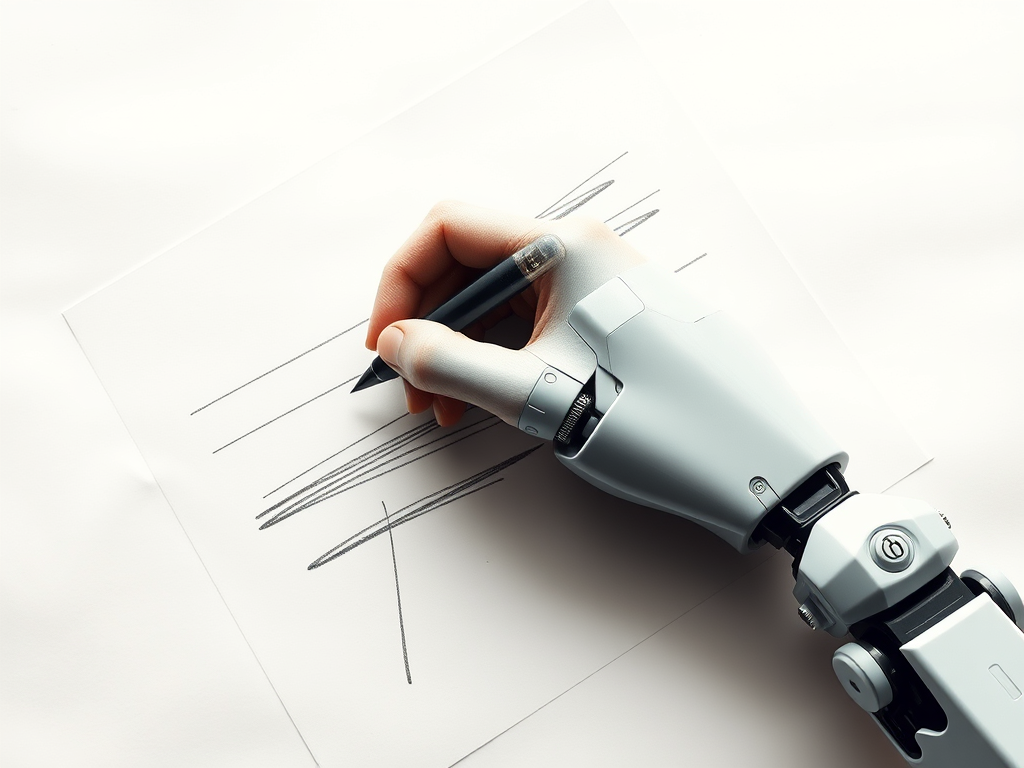

Dieser beiläufige Verzicht auf eigene Textproduktion signalisiert eine tiefere Verschiebung: Die Arbeit am Gedanken, der Weg durch Sprache zur Erkenntnis, wird delegiert. Das Schreiben wird entkoppelt vom Denken, das Ergebnis ersetzt den Prozess. Was früher Mühe bedeutete – Formulieren, Ringen, Redigieren – wird heute als Aufwand betrachtet, den man sich sparen kann. Und hier, so scheint es, öffnet sich ein philosophisches Problem von beträchtlicher Tiefe.

Das Ende der Anstrengung?

Die Menschheit hat sich über Jahrhunderte entlang ihrer Werkzeuge definiert. Aber nie zuvor war ein Werkzeug so sehr in der Lage, den Ausdruck des Selbst zu imitieren. Wenn wir generative KI nutzen, um unsere Gedanken zu „vertexten“, geben wir nicht nur den Schreibakt, sondern auch ein Stück unserer Autorschaft ab.

Der Text, einst Beweis des Denkens, wird zum Produkt eines Systems, das gelernt hat, wie Denkende schreiben, nicht wie sie zu denken.

Die Gefahr liegt weniger in der „Täuschung“ durch KI, sondern in der schleichenden Verlernung, überhaupt etwas zu sagen zu haben. Wer regelmäßig delegiert, entwickelt keine Sprache für die eigene Unsicherheit, keine Stilistik des Zögerns, keine Haltung zum Problem. Das Schreiben verliert seine Funktion als Ort der Fertigung des Gedankens. Es bleibt zurück eine Oberfläche ohne Tiefe, eine Aussage ohne Absender, ein Dokument ohne Herkunft.

Wenn dieser Trend anhält, wird das akademische Schreiben und mit ihm der akademische Habitus, zunehmend formalisiert. Was zählt, ist die Einhaltung von Konventionen, nicht deren reflexive Auseinandersetzung.

Die Studierenden, die sich heute KI-generierte Hausarbeiten geben lassen, sind die Professionals von morgen, die sich keine Gedanken mehr machen, sondern sie „machen lassen“. Und die Frage, wer hier eigentlich spricht – wer denkt, wer zweifelt, wer steht für das Geschriebene ein – gerät ins Rutschen.

Bildung als Ort des Unvollkommenen

Es gehört zur Würde des Menschen, unvollkommen zu sein. Wer schreibt, offenbart sich. Fehler, Schwächen, argumentative Sprünge – sie sind nicht Makel, sondern Merkmale des eigenen Denkens.

Bildung lebt von dieser Verletzlichkeit, von der Bereitschaft, sich im Prozess zu zeigen. Zu berichtigen, zu kontrollieren aber auch berichtigt und kontrolliert zu werden. In einer durchoptimierten KI-Kommunikation droht genau das zu verschwinden.

Philosophisch betrachtet, stellt sich damit die Frage:

Wenn niemand mehr schreibt – wer denkt dann noch?

Wenn der Text nicht mehr getragen ist von Subjektivität, sondern „funktional“ erzeugt wird – was wird aus dem Selbst? Bildung wird so zur Simulation: Eine Choreografie intellektueller Bewegung, bei der das Denken selbst nicht mehr stattfindet.

Ein Plädoyer für das Eigentum am Ausdruck

Der Weg aus dieser Krise führt nicht über Technikfeindlichkeit oder Verbote, sondern über ein neues Bewusstsein für das Schreiben als Handlung. Studierende und Professionals – brauchen Räume, in denen sie schreiben dürfen, ohne perfekt sein zu müssen. Texte dürfen wieder tastend, subjektiv, widerständig sein. Lehrende müssen ermutigen, nicht nur bewerten.

Und Gesellschaften müssen sich fragen, ob eine Generation, die alles schreiben kann, aber nichts mehr sagen will, tatsächlich „effizienter“ ist – oder nur sprachloser.

Die rasante Verbreitung generativer KI in Bildung und Berufsleben markiert weit mehr als einen technologischen Wandel – sie stellt eine epistemische und kulturelle Herausforderung dar. Was zunächst als Werkzeug zur Effizienzsteigerung eingeführt wurde, droht sich in eine strukturelle Auslagerung kognitiver Leistung zu verwandeln. Die Beobachtungen im schulischen wie beruflichen Umfeld zeigen, wie sich Menschen unterschiedlicher sozialer Milieus zunehmend von der eigenen sprachlichen Ausdrucksarbeit distanzieren – nicht aus Unfähigkeit, sondern aus Pragmatismus, Bequemlichkeit oder schlicht aus Gewöhnung. Dabei verflacht nicht nur die sprachliche Oberfläche, sondern auch das, was sie einmal transportierte: Position, Haltung, Denken.

Diese Entwicklung führt uns zu einer entscheidenden bildungsphilosophischen Frage: Was bedeutet Bildung in einer Zeit, in der das Denken delegierbar wird? Wenn Autorschaft zu einer formalen Zuschreibung wird, nicht mehr zu einem Prozess innerer Auseinandersetzung, droht die Erosion eines zentralen Bildungsideals: jener mühsamen, aber produktiven Aneignung der Welt durch Sprache. Die Nutzung von KI steht dabei exemplarisch für eine größere kulturelle Bewegung, in der Effizienz über Tiefe, Ergebnis über Prozess und Funktionalität über Sinn gestellt wird.

Statt KI zu dämonisieren, bedarf es eines kritischen pädagogischen Umgangs mit ihr – einer Haltung, die nicht Technikfeindlichkeit, sondern Technikverantwortung kultiviert. Das bedeutet: Räume zu schaffen, in denen nicht das perfekte Produkt zählt, sondern der unsichere, tastende, persönliche Gedanke. Gerade in einem Bildungssystem, das sich nicht allein an Output orientieren darf, ist es unsere Aufgabe, das Eigentum an Sprache, Gedanken und Fehlern zu verteidigen – gegen die Versuchung, sich selbst durch eine glattgebügelte Simulation zu ersetzen.

Quellen und Literatur

- Goode, Lauren / Calore, Michael / Drummond, Katie: Let’s Talk About ChatGPT and Cheating in the Classroom. In: WIRED – Uncanny Valley Podcast, 2024. Online unter: https://www.wired.com/story/uncanny-valley-podcast-chatgpt-cheating-in-the-classroom/ (Abruf: 29.05.2025). ↩︎

- Times of India: Why ChatGPT Is Disrupting Liberal Arts But Not STEM in US Colleges. 2024. Online unter: https://timesofindia.indiatimes.com/education/news/why-chatgpt-is-disrupting-liberal-arts-but-not-stem-in-us-colleges/articleshow/121394004.cms (Abruf: 29.05.2025). ↩︎

- TEQSA – Tertiary Education Quality and Standards Agency: The Evolving Risk to Academic Integrity Posed by Generative Artificial Intelligence. Canberra 2024. Online unter: https://www.teqsa.gov.au/sites/default/files/2024-08/evolving-risk-to-academic-integrity-posed-by-generative-artificial-intelligence.pdf (Abruf: 29.05.2025). ↩︎

- Schwartz, Sarah: More Teachers Are Using AI Detection Tools. Here’s Why That Might Be a Problem. In: Education Week, 10.04.2024. Online unter: https://www.edweek.org/technology/more-teachers-are-using-ai-detection-tools-heres-why-that-might-be-a-problem/2024/04 (Abruf: 29.05.2025). ↩︎